今年非常看好AI视频生成领域,甚至几个月前都注册了一个域名打算做个AI视频生成工具的导航网站,过年期间没事的时候也开始基于一个模板在修改页面,但一想到要做大量的内容也很头疼,恰好今天OpenAI扔出了其王炸视频大模型Sora,看演示视频帧的太震撼了,只需要使用自然语言就可以生成一分钟的高清视频,下面先看这个被引用最多的视频

特意用剪映做了个开头打字特效并添加上了背景音乐,要不仔细看背景中的文字和人群还真以为是一段街拍视频,有远景、近景、特写镜头,眼镜和水的倒影这种细节都有,不愧称之为作为世界模拟器的视频生成模型。

提示词:A stylish woman walks down a Tokyo street filled with warm glowing neon and animated city signage. She wears a black leather jacket, a long red dress, and black boots, and carries a black purse. She wears sunglasses and red lipstick. She walks confidently and casually. The street is damp and reflective, creating a mirror effect of the colorful lights. Many pedestrians walk about.(一位时尚女性走在东京的街道上,街道上到处都是暖色调的霓虹灯和动画城市标志。她身穿黑色皮夹克、红色长裙和黑色靴子,手拿黑色皮包。她戴着太阳镜,涂着红色唇膏。她走起路来自信而随意。街道潮湿而反光,与五颜六色的灯光形成镜面效果。许多行人走来走去。)

而且今天还发布了一篇关于Sora更详细的技术报告,下面我们一起来看看Sora除了文生视频之外,还有哪些功能吧。

1、可创建各种尺寸的视频

Sora 可以采样宽屏 1920x1080p 视频、垂直 1080×1920 视频以及介于两者之间的所有视频。这使得 Sora 可以直接以其原生宽高比为不同设备创建内容。它还可以让我们在生成全分辨率之前,快速用较低分辨率进行内容原型设计,而且都是使用同一个模型。

2、语义理解

可以跟 Dall-E·3 出图一样,只需要使用自然语言描述GPT就可以把比较短的提示词转换为更详细的提示词,然后生成符合预期的更准确的高质量视频

提示词:a woman wearing blue jeans and a white t-shirt taking a pleasant stroll in Mumbai India during a beautiful unset.(在印度孟买,一位身着蓝色牛仔裤和白色 T 恤的女士在美丽的夕阳下漫步。)

3、图生视频

Sora 同样可以跟很多视频模型一样,使用图片生成视频

|

|

|

In an ornate, historical hall, a massive tidal wave peaks and begins to crash. Two surfers, seizing the moment, skillfully navigate the face of the wave.

在一座华丽的历史大厅里,巨大的浪潮达到顶峰并开始崩塌。两名冲浪者抓住时机,熟练地驾驭海浪。 |

4、扩展生成的视频

Sora 还能够在时间上向前或向后扩展视频。虽然官方解释的是“它们都是从生成的视频片段开始向后延伸的。因此,这四个视频的开头都不同,但所有四个视频的结局都是相同的。” 但我感觉这三个演示视频更像是从10秒左右往前扩展的,以后做互动视频估计更轻松,类似《黑镜》根据不同的选择导致不同的结果,直接带来视频玩法的多样性~

可以使用此方法向前和向后扩展视频以产生无缝的无限循环视频。

5、视频到视频编辑

Sora 能够零镜头地改变输入视频的风格和环境,风格转换再也不用愁了~

6、连接视频

还可以使用 Sora 在两个输入视频之间逐渐进行插值,从而在具有完全不同主题和场景构成的视频之间创建无缝过渡。在下面的示例中,中心的视频插值在上侧和下侧的相应视频之间。或许以后也可以来个11s国风换装秀?

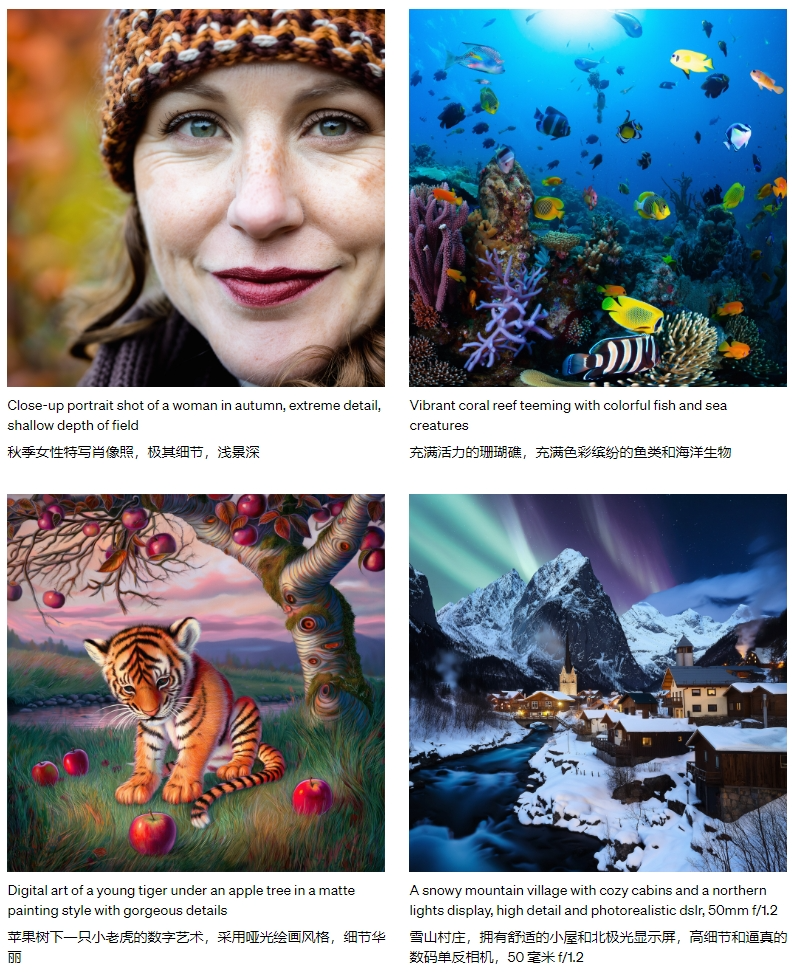

7、图像生成能力

Sora 还能够生成图像。可以通过在时间范围为一帧的空间网格中排列高斯噪声块来实现这一点。该模型可以生成各种尺寸的图像,分辨率高达 2048×2048。作为一个视频模型拿来生成图片,这是要降维打击自家的Dall-E么。。。

8、新兴的模拟功能

当视频模型在大规模数据上进行训练时,会展现出许多有趣的新能力。这些能力使得“Sora”能够模拟现实世界中人类、动物和环境的某些方面。这些特性是自然形成的,而不是通过为模型添加关于3D、对象等方面的特定指导(即“归纳偏见”)来实现的。它们完全是因为大规模训练而出现的现象。简单来说,就是通过大量的数据训练,视频模型能学会一些模拟现实世界的技能,而这并不需要事先特别设定模型去学习这些技能。

1)3D 一致性

Sora 可以生成带有动态摄像机运动的视频。随着摄像机的移动和旋转,人和场景元素在三维空间中一致移动。

2)相干和一致性

在制作长视频时,保持视频从开始到结束在视觉上的连贯性是一个难点。但是”Sora”通常能够很好地处理这个问题。它能记住视频中的人物、动物和物体,即使它们暂时消失在镜头之外或被其他东西遮挡。此外,它还能在一个视频样本中,对同一个角色进行多次拍摄,确保角色的外观在视频的各个部分中保持一致。

3)与世界互动

“Sora”能够模拟一些简单的、与世界互动的行为。比如,它能展示一个画家在画布上作画,随着时间画布上的画作会逐渐增多;或者展示一个人吃汉堡,汉堡会因为被咬而出现咬痕。这说明”Sora”能够理解并模拟这些行为对周围环境产生的影响。

3)模拟数字世界

“Sora”能够模拟并控制像《Minecraft》这样的视频游戏中的角色和环境,而且做到很高的真实度。而且,只需要给”Sora”一些相关的提示,比如提到“Minecraft”,它就能自动展示这些能力,无需提前进行特定的训练或准备。

通过不断增强和扩大视频模型的能力,可以更好地模拟现实世界和数字世界,包括其中的所有事物,如物体、动物和人类。这说明,随着技术的进步,我们有望开发出能够更真实、更精准地反映和模拟现实和虚拟环境的技术。

当然”Sora”在模拟现实世界和其中互动时还存在一些问题。它可能无法精确地模拟某些物理过程,比如物体的破碎,或者在模拟吃食物等动作时,不能总是准确地反映出物体状态的改变(如食物减少)。此外,视频模型在模拟较长时间内容时可能会出现逻辑不连贯或突然出现不应该出现的物体等问题。

非常期待Sora的到来,人人制作AI大片的时代来临了~~

更详细的内容可以参考官方的文档:

https://openai.com/sora

https://openai.com/research/video-generation-models-as-world-simulators